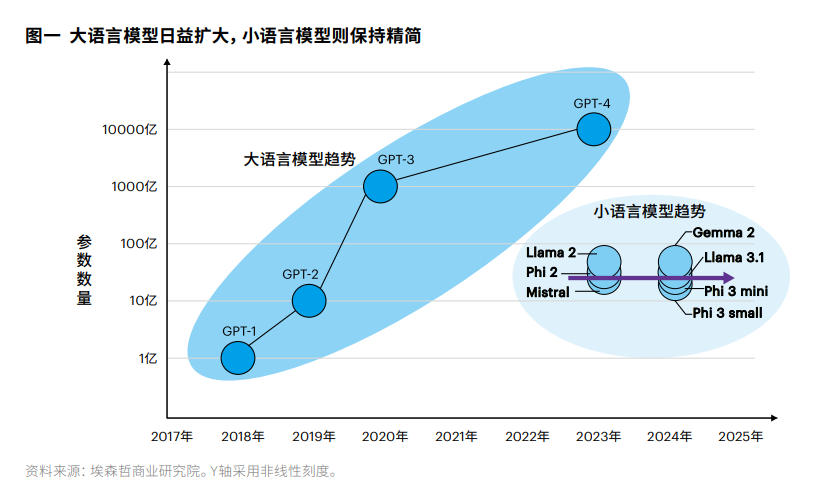

生成式AI的发展之路上始终奉行着这样一条简单却有效的理念:规模代表智能水平。自2017年Transformer架构问世以来,各家模型开发团队持续不断地在为下一代模型增加数据量、参数规模和算力投入。例如,早期的生成式AI模型约含3.4亿参数,1 而近期模型参数规模已达数千亿之巨。

然而,用千亿参数模型处理常规任务并不合理。大语言模型(LLM)无疑能力强大,但训练与运行成本高昂,需要耗费海量的算力资源,还会引发数据隐私担忧。一些企业已经通过合理配置硬件资源、改进数据处理方法、优化算法和模型结构等方式来降低模型成本。不过,更经济的大语言模型并非AI价值重构的唯一方向,另辟蹊径同样前途光明。

1. 《什么是基础模型》,亚马逊云科技,https://aws.amazon.com/what-is/foundation-models/ 。

小语言模型崭露头角

小语言模型的参数通常远低于100亿,却能在特定任务中提供企业级性能(见图一)。此类模型对数据、算力和内存的需求更少,因此训练、部署与维护成本都会显著降低。

小语言模型更易微调,运行速度更快,且更适合直接嵌入业务流程。许多大模型无法部署的场景,例如,边缘计算型设备,以及对速度、隐私和控制要求严苛的系统中,正是小语言模型的用武之地。它们能够以精准性和专业性弥补规模的不足。基于人类反馈的强化学习(RLHF)等技术,小模型能使输出内容与特定用户的预期、企业业务场景保持紧密一致,进一步提升性能。

大、小两类语言模型的设计目标截然不同。大语言模型如同通用处理器,灵活、强大、擅长执行多种任务;小语言模型则更像嵌入式控制器,轻量、专注、为单项目标而优化。简言之,大语言模型仍将赋能前沿创新,而小语言模型会高效地驱动其他一切。以下五大特性令小语言模型极具实用价值:

首先是成本效益。如前所述,小语言模型所需的基础设施、算力和协调工作更少。例如,有研究指出,7亿参数级别的小模型相比70亿至175亿参数的超大模型,在延迟、功耗和浮点运算量(FLOPs)等方面成本低10到30倍。2 对资本或云资源有限的组织而言,这打开了一扇机遇之门,无需超大规模投资即可创建富有影响力的AI系统。

第二项特性在于速度与精准度。与通用大模型不同,小语言模型可针对单一任务或领域加以微调,降低复杂性和延迟。微调将加快推理速度,这对需要实时反馈的应用程序至关重要,譬如在聊天界面、交易处理和预测诊断中,毫秒级延迟都有可能影响体验。

第三项特性则是战略差异化。小语言模型允许企业嵌入专有的数据、流程和场景,打造与业务运营高度契合的AI,不必再进行简化和抽象化加工。相比之下,现成的通用模型(无论大小)虽可保证性能,却不能适应细微差异。

第四项特性涉及能源与算力约束。多数企业都无力运行万亿参数级模型,边缘计算场景尤其如此。小语言模型则能提供可持续的替代方案,这既符合环保目标,也契合在移动端、物联网(IoT)及离线设备中部署AI的现实需求。

第五项特性关乎数据隐私与主权。小语言模型可本地部署或植入边缘位置,将敏感信息保留在企业内。这对医疗、金融、国防等行业极为关键。

总之,小语言模型不仅性能优异,特性还更加贴合企业需求,更适应受限环境,也契合大多数商业问题本身就非常具体的实际情况。面对当前高度不确定的商业环境,小语言模型的吸引力将持续增长。此类工具可以通过多重方式提升运营韧性,例如,部署速度更快、更易适配行业的特定需求,且在算力受限的环境中能够更高效地运行。

例如,一家大型流媒体企业已部署了多款定制化的小语言模型,以此优化核心运营。这些模型能够提升算法性能、降低计算成本、提高系统效率,并实时提升客户体验。例如,通过减少跨越设备和网络的缓冲延迟,小语言模型提升了流媒体质量,小模型还能够分析参与度指标,为数以百万计的用户提供更精准的内容推荐。

埃森哲内部IT团队和商业研究院也在组建团队,探索小语言模型为企业创造价值的路径。例如,IT团队利用埃森哲“AI Refinery”平台,助力企业将原始的AI技术转化为可扩展的企业级解决方案,重塑企业的财务职能。我们的目标在于,用小语言模型简化高负荷、低价值的任务(如对账与报表),并实现更具适应力和环境感知能力的运营(如基于情境的规划和动态化的预算编制)。此外,埃森哲商业研究院团队则在关注利用小语言模型处理常规任务(例如文献总结与调研编码),同时尝试用大语言模型完成高价值任务(如战略前瞻建模和跨领域知识发现)。

2. 《小语言模型是智能体的未来》,arXiv,2025年6月2日,https://arxiv.org/pdf/2506.02153

齐头并进,适者为佳

展望生成式AI的未来,我们不必、也不应在大模型与小模型之间二选一。可以肯定的是,大、小两类语言模型将持续并存——大语言模型仍将推动复杂的多领域推理,小语言模型则可在边缘计算环境、设备内部,以及受到延迟、隐私或基础设施等条件约束的系统中运行。若想借助AI赢得未来竞争,企业领导就必须在适当的场景中部署适合的模型。为了最大限度地利用生成式AI获益,企业需要开展广泛的运营模式变革,其中有七项经验值得借鉴:

第一,制定明确目标。明确AI投资的最终业务价值至关重要。企业应将模型部署聚焦于可量化成果,如提升客户体验、降低运营成本、优化供应链效率或缩短决策周期。同时,企业应将整体目标拆解为阶段性指标,便于监控和评估投资回报。

第二,以影响力而非模型种类来衡量成功。切勿沉迷于模型规模或技术复杂性。衡量AI成功的核心是其对业务的实际影响,如提高用户留存率、缩短响应时间或提高运营效率。将模型视作工具而非结果,能够避免技术驱动导致的业务目标偏差。

第三,动态追踪AI发展格局。AI技术与生态系统更新极快,新的模型架构、优化算法和基础设施方案层出不穷。企业需要建立持续的技术扫描和试验机制,确保部署策略随生态演进而快速调整,避免落后于竞争对手。

第四,构建模块化架构。设计灵活、模块化的AI基础设施,使新模型或算法可以无缝集成,而不会被单一供应商锁定。通过微服务化设计、标准化接口和可插拔组件,企业可以实现快速迭代和低成本扩展。

第五,强化数字核心。可扩展的AI战略建立在坚实的数据和系统基础之上。企业应确保数据清洁、标准化,并在不同系统间实现整合。同时建立健全的数据治理机制,确保数据安全、合规与可追踪,为模型的持续优化提供可靠支撑。

第六,探索物联网与边缘场景。在低延迟、高隐私保护或基础设施受限的环境中,小语言模型能够提供轻量级、高效的AI服务。例如,边缘设备可实时处理数据并作出智能决策,从而减少对云端的依赖,提升用户体验和运营灵活性。

第七,迅速适应。AI部署不可孤立于外部环境。企业需要建立AI卓越中心,实时解读监管政策、地缘政治风险和市场变化,并快速形成本地化部署策略。同时,通过灵活的运维和快速迭代能力,使小语言模型能够在复杂环境中持续发挥价值。

史蒂夫·考特尼(Steve Courtney)

埃森哲董事总经理、企业科技战略、研究与创新主管

马修·拉戈津斯基(Matthew Lagodzinski)

埃森哲董事总经理、IT部门生成式AI负责人

苏瑞亚·穆克吉(Surya Mukherjee)

埃森哲商业研究院研究总监

业务垂询:contactus@accenture.com

216.73.216.46